Los costos de producción de NVIDIA se desploman a Asia: el 90% ya no es estadounidense

La estructura de costos de Nvidia ha experimentado un cambio radical en su dependencia geográfica. Según datos recopilados por Bloomberg, los proveedores asiáticos ahora representan aproximadamente el 90% de los costos de producción de la compañía, un salto significativo respecto al 65% registrado hace un año. Esta cifra abarca la cadena de suministro establecida para centros de datos, que incluye la fabricación de TSMC, la memoria HBM de SK Hynix y Samsung, y el ensamblaje de servidores por parte de Foxconn y Quanta.

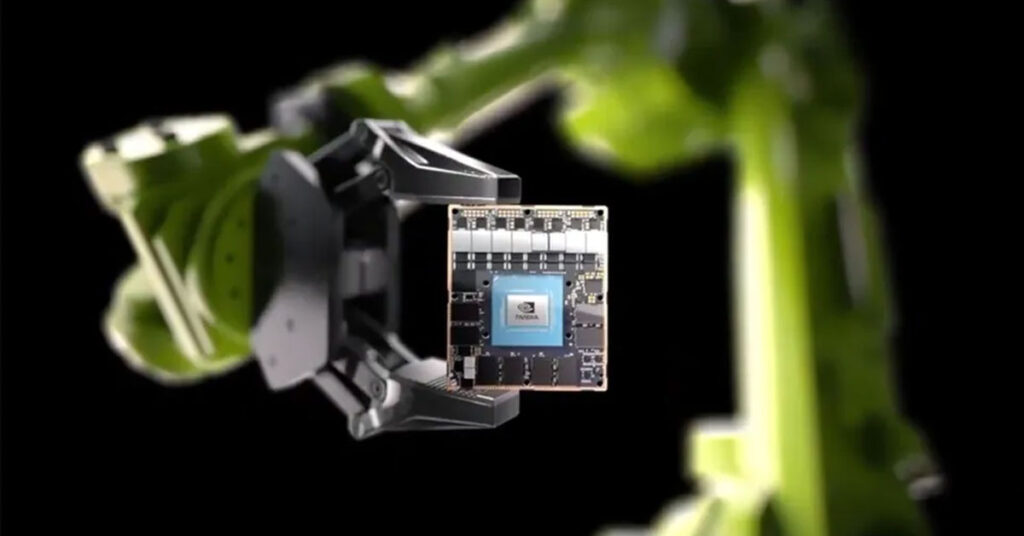

La expansión del hardware físico tensiona la capacidad de 3nm

La empresa de Santa Clara está integrando nuevas categorías de productos de inteligencia artificial física que compiten por los mismos recursos de sus proveedores asiáticos. La plataforma de robótica Jetson Thor, lanzada en agosto del año pasado, se basa en la arquitectura Blackwell y se fabrica en el proceso de 3nm de TSMC. El módulo tope de gama, el T5000, ofrece 2,070 FP4 TFLOPS con 128 GB de memoria LPDDR5X, mientras que la variante de menor costo, el T4000 presentado en el CES 2026, proporciona 1,200 FP4 TFLOPS con 64 GB a un precio de $1,999 por unidad en volumen. Ambos utilizan núcleos de CPU Arm Neoverse-V3AE y memoria LPDDR5X sourced de Samsung o SK Hynix.

Estos módulos de robótica compiten por las inicios de obleas de 3nm de TSMC junto con las GPUs de centros de datos Blackwell. Socios como Boston Dynamics y Amazon Robotics están desarrollando sobre esta plataforma, y LG ha indicado que está «explorando una colaboración estratégica en inteligencia artificial física», incluyendo el ecosistema de robótica, según reportó Bloomberg. Otra línea de productos basada en Blackwell que compite por la misma capacidad de obleas es el SoC automotriz DRIVE AGX Thor.

La escasez de memoria LPDDR5X y el fin de los módulos anteriores

Aunque ninguno de estos productos de inteligencia artificial física requiere el empaquetado avanzado CoWoS de TSMC —que sigue siendo el principal cuello de botella para las GPUs de centros de datos—, sí consumen capacidad de obleas de 3nm y memoria LPDDR5X de origen asiático, recursos que ya se encuentran restringidos. Esta dinámica del mercado de la memoria está afectando simultáneamente a los productos anteriores de Nvidia. A finales de abril, se informó que la compañía aceleró los plazos de fin de vida para sus módulos Jetson TX2 y Xavier debido a la escasez de suministro de memoria LPDDR4. Samsung ha abandonado la fabricación de LPDDR4, y la demanda impulsada por la inteligencia artificial ha redirigido la capacidad de memoria hacia productos de mayor margen.

Esto obliga a los clientes de Jetson a migrar a los módulos Orin o Thor, que utilizan memoria LPDDR5X de los mismos proveedores asienses cuya capacidad ya está tensionada por la demanda de HBM y DRAM para centros de datos. El empaquetado avanzado CoWoS de TSMC para GPUs de centros de datos está creciendo a una tasa anual compuesta del 80%, según señaló el responsable de empaquetado de TSMC en CNBC el mes pasado, y los chips fabricados en la Fab 21 de TSMC en Arizona aún se envían a Taiwán para su empaquetado.

La brecha entre la inversión en EE. UU. y la realidad asiática

Nvidia se comprometió a $500 mil millones en fabricación de servidores en EE. UU. el año pasado, con Foxconn y Wistron, mientras que Amkor y SPIL están construyendo instalaciones de empaquetado avanzado en Arizona. Sin embargo, estas operaciones aún no están a escala de producción, y las líneas de productos de inteligencia artificial física están ampliando el rango de componentes de origen asiático más rápido de lo que la capacidad doméstica puede absorberlos.

Fuente: Tom’s Hardware